Today I Learn

신경망 학습

신경망이 잘 학습되고 있는지 보여줄 수 있는 손실함수(loss function)과 가중치 매개변수 조정을 통해 손실함수를 줄이는 방법에 대해 알아봤습니다.

오차역전파(backpropagation)

수치미분보다 더 효율적으로 매개변수의 기울기를 계산할 수 있는 오차역전파에 대해 알아봤습니다.

[백준 문제풀이] 약점 체크

코딩테스트를 위한 백준 문제 풀어보기

pytorch로 CNN 구현하기

pytorch로 CNN모델을 구현해봤습니다. 추가적으로 model을 다시 사용할 수 있도록 저장하는 방법도 알아봤습니다.

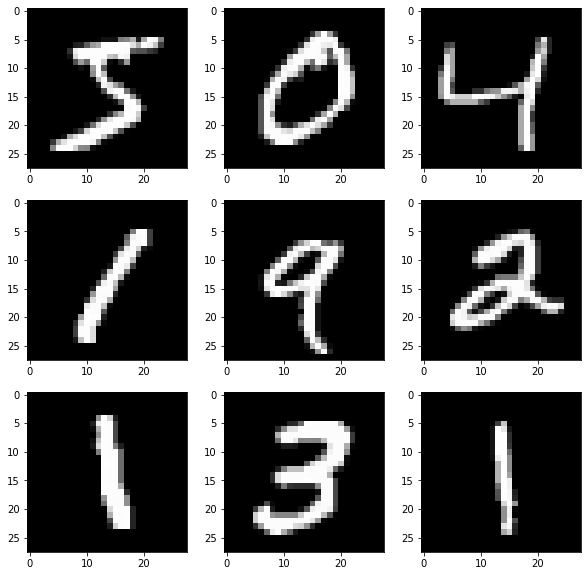

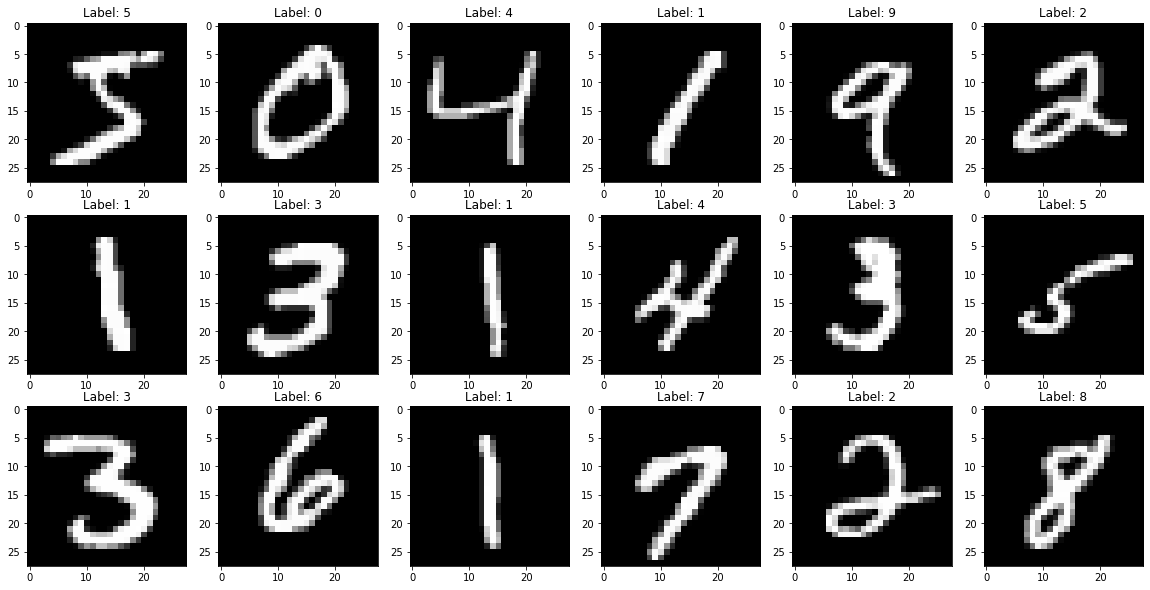

pytorch로 mnist 분류하기

pytorch로 mnist 분류 MLP모델을 구현하고 optimizer, lr scheduler, regularization, dropout, batch normalization의 적용 전 후 성능차이를 비교해봤습니다.

신경망과 활성화 함수

밑바닥부터 시작하는 딥러닝을 읽고 신경망과 활성화 함수에 대해 정리해봤습니다.

Pytorch tutorial

딥러닝 프레임워크 파이토치에 대해 알아보자

[백준 문제풀이] 기본기

코딩테스트를 위한 백준 문제 풀어보기

퍼셉트론이란

밑바닥부터 시작하는 딥러닝을 읽고 딥러닝의 기원이 되는 알고리즘인 퍼셉트론에 대해 정리해봤습니다.

[멋쟁이사자처럼] OBG의 TIL 페이지 개설

Socar Bootcamp Peer Group OBG(Old But Gold)의 TIL 페이지입니다.